Computational Empowerment

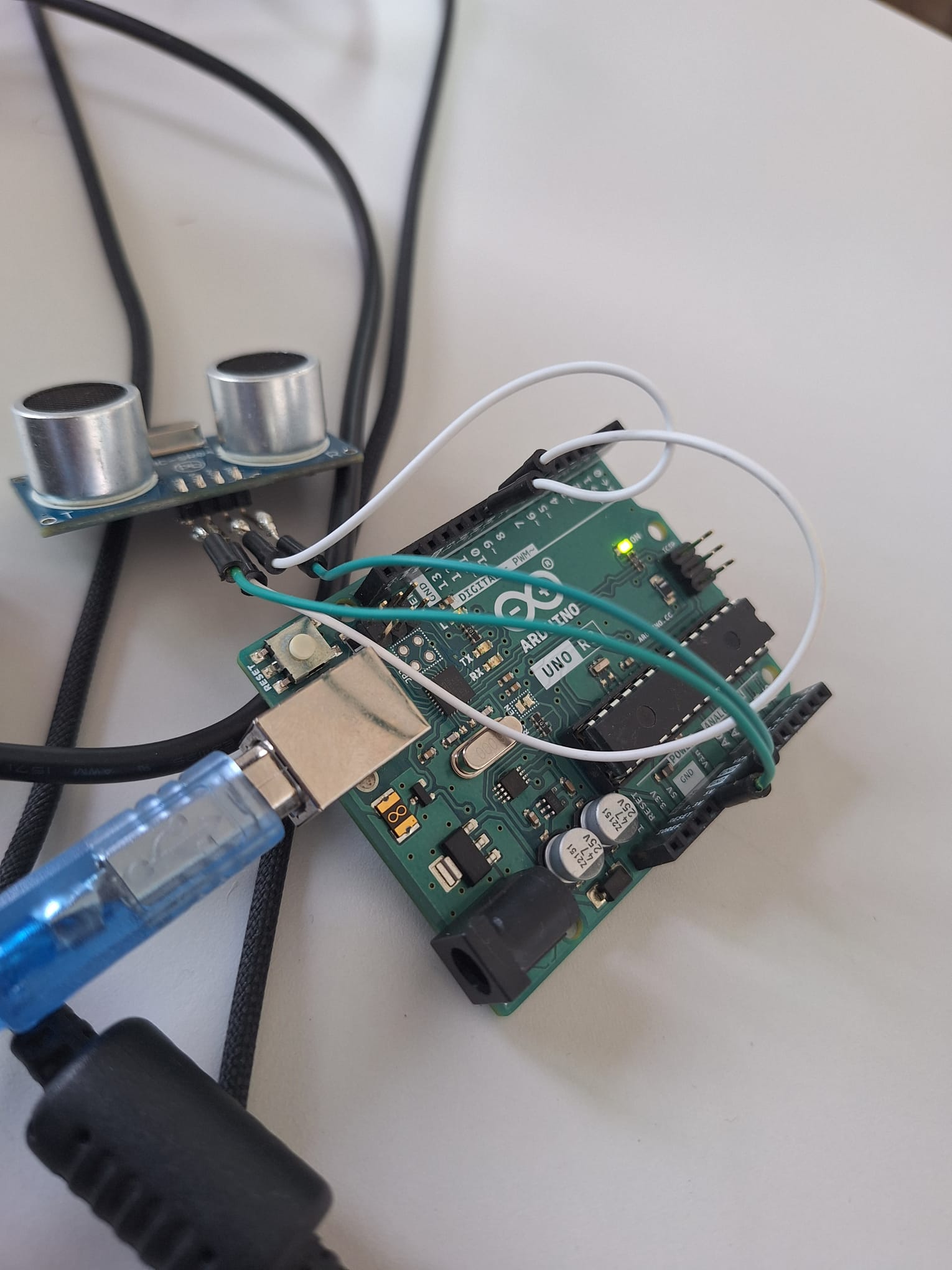

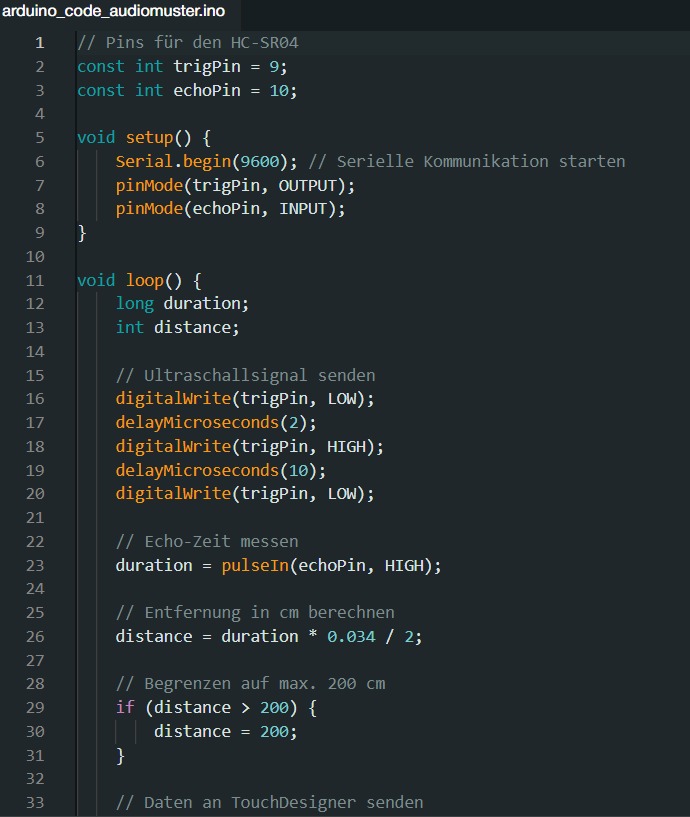

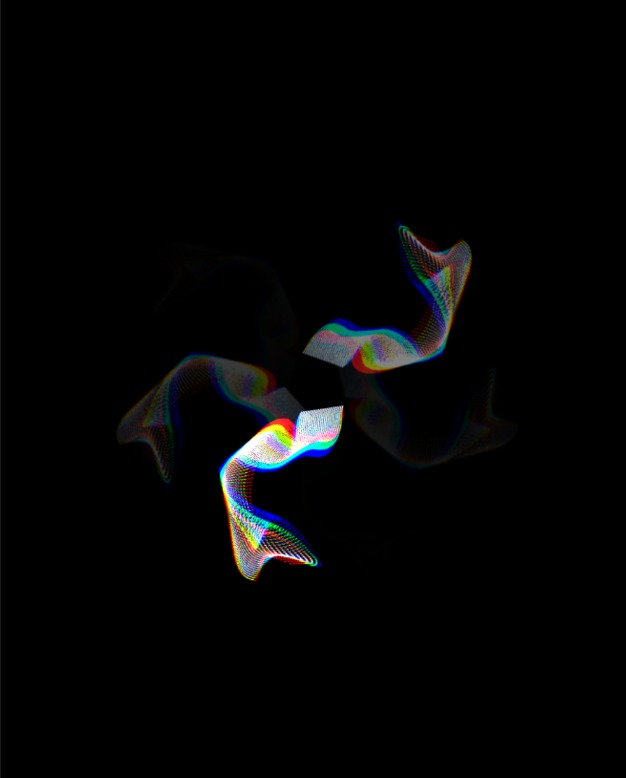

In diesem Projekt entwickelten ein Kommilitone und ich ein audioreaktives, interaktives Muster mit TouchDesigner, kombiniert mit einem MIDI-Controller sowie einem Entfernungssensor, der an ein Arduino angeschlossen war. Das visuelle Muster reagierte in Echtzeit auf Kick-, Drum- und Bass-Elemente der Musik.

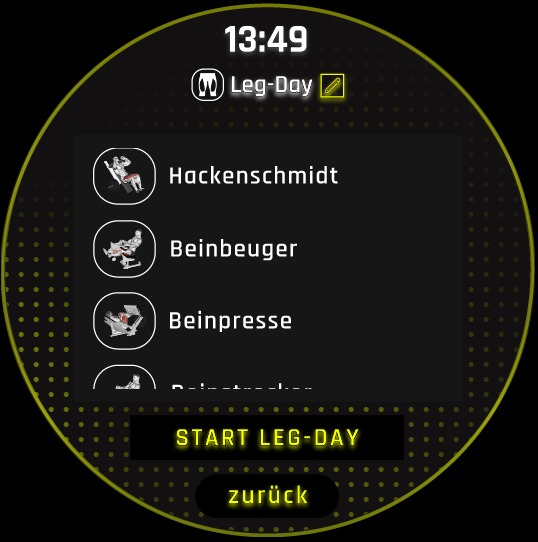

Über programmierte MIDI-Controls konnten Nutzer:innen die Form und das Verhalten des Musters beeinflussen und zwischen drei verschiedenen Songs wählen. Zusätzlich führte die Interaktion mit dem Entfernungssensor – durch das Platzieren der Hand in einem Abstand von bis zu 20 cm – dazu, dass das Muster intensiver und deutlich heller wurde.

Dieses Projekt stellte unsere erste Erfahrung mit Coding und TouchDesigner dar und legte den Fokus auf Experimentieren, Interaktion und Lernen durch Praxis.